वाक्य - विन्यास:

हगिंग फेस द्वारा प्रदान की जाने वाली कई प्रकार की सेवाएँ मौजूद हैं लेकिन इसकी व्यापक रूप से उपयोग की जाने वाली सेवाओं में से एक 'एपीआई' है। एपीआई विभिन्न अनुप्रयोगों के लिए पूर्व-प्रशिक्षित एआई और बड़े भाषा मॉडल की बातचीत की अनुमति देता है। हगिंग फेस निम्नलिखित में सूचीबद्ध विभिन्न मॉडलों के लिए एपीआई प्रदान करता है:

- पाठ निर्माण मॉडल

- अनुवाद मॉडल

- भावनाओं के विश्लेषण के लिए मॉडल

- वर्चुअल एजेंटों (बुद्धिमान चैटबॉट) के विकास के लिए मॉडल

- वर्गीकरण और प्रतिगमन मॉडल

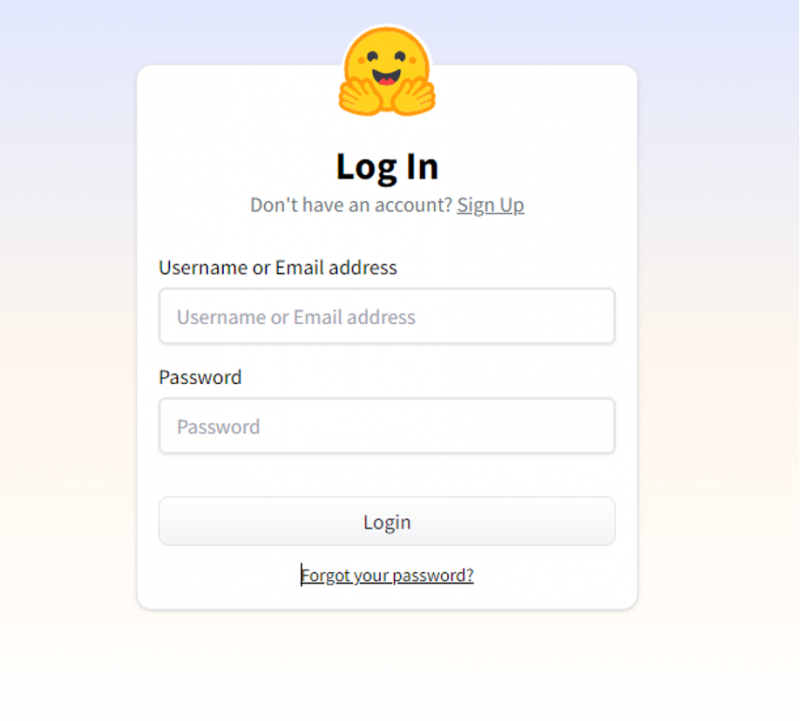

आइए अब हगिंग फेस से हमारी वैयक्तिकृत अनुमान एपीआई प्राप्त करने की विधि खोजें। ऐसा करने के लिए, हमें सबसे पहले हगिंग फेस की आधिकारिक वेबसाइट पर खुद को पंजीकृत करके शुरुआत करनी होगी। अपने क्रेडेंशियल्स के साथ इस वेबसाइट पर साइन अप करके हगिंग फेस के इस समुदाय में शामिल हों।

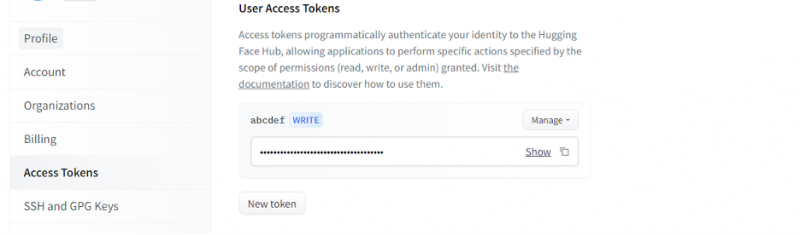

एक बार जब हमें हगिंग फेस पर एक खाता मिल जाता है, तो हमें अब अनुमान एपीआई का अनुरोध करना होगा। एपीआई का अनुरोध करने के लिए, खाता सेटिंग्स पर जाएं और 'एक्सेस टोकन' चुनें। एक नयी विंडो खुलेगी। 'नया टोकन' विकल्प चुनें और फिर पहले टोकन का नाम और उसकी भूमिका 'WRITE' प्रदान करके टोकन उत्पन्न करें। एक नया टोकन उत्पन्न होता है. अब, हमें इस टोकन को सहेजना होगा। इस बिंदु तक, हमारे पास हगिंग फेस से हमारा टोकन है। अगले उदाहरण में, हम देखेंगे कि हम अनुमान एपीआई प्राप्त करने के लिए इस टोकन का उपयोग कैसे कर सकते हैं।

उदाहरण 1: हगिंग फेस इंफ़रेंस एपीआई के साथ प्रोटोटाइप कैसे करें

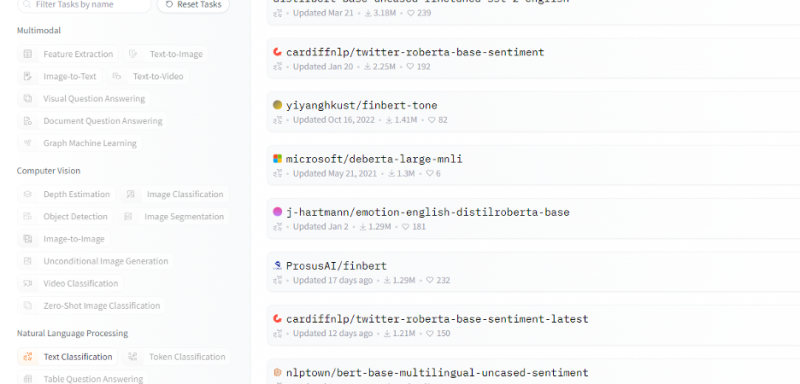

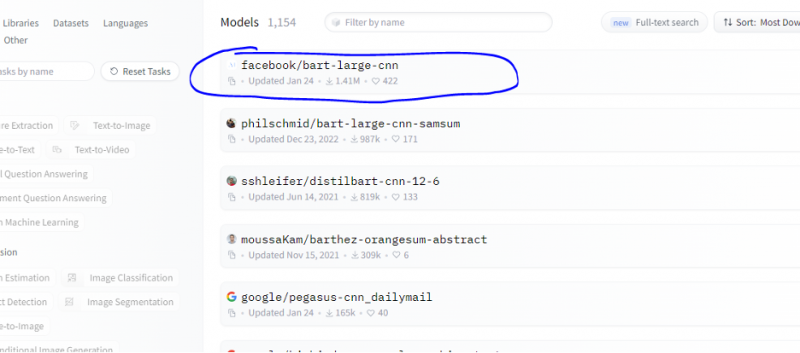

अब तक, हमने हगिंग फेस के साथ शुरुआत करने की विधि पर चर्चा की और हमने हगिंग फेस से एक टोकन आरंभ किया। यह उदाहरण दिखाता है कि हम एक विशिष्ट मॉडल (मशीन लर्निंग) के लिए एक अनुमान एपीआई प्राप्त करने और इसके माध्यम से भविष्यवाणियां करने के लिए इस नव निर्मित टोकन का उपयोग कैसे कर सकते हैं। हगिंग फेस के मुखपृष्ठ से कोई भी मॉडल चुनें जिसके साथ आप काम करना चाहते हैं जो आपकी समस्या के लिए प्रासंगिक है। मान लीजिए कि हम पाठ वर्गीकरण या भावना विश्लेषण मॉडल के साथ काम करना चाहते हैं जैसा कि इन मॉडलों की सूची के निम्नलिखित स्निपेट में दिखाया गया है:

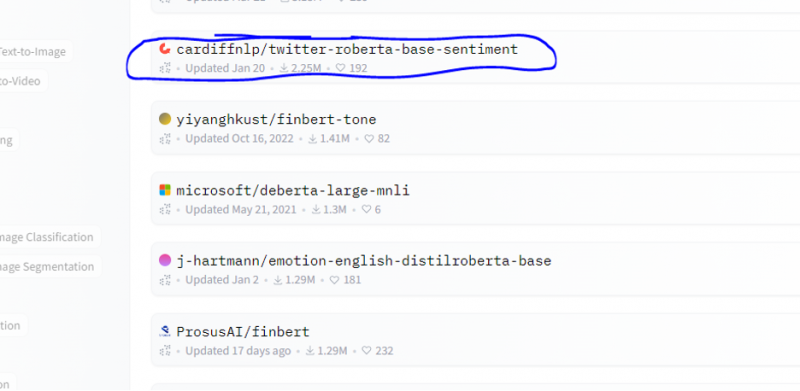

हम इस मॉडल से भावना विश्लेषण मॉडल चुनते हैं।

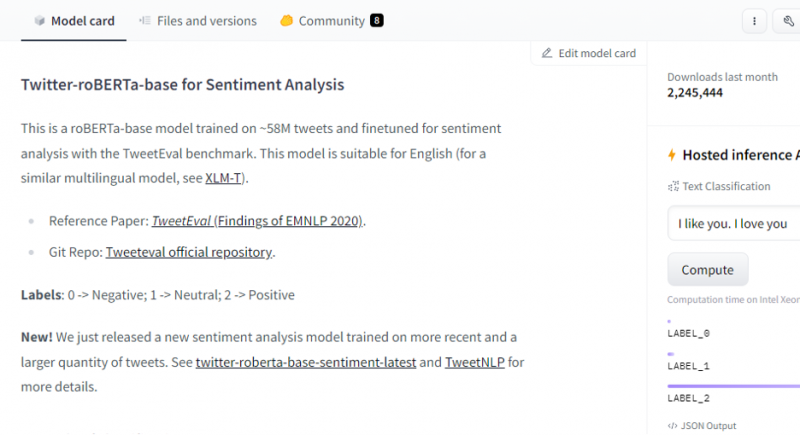

मॉडल का चयन करने के बाद उसका मॉडल कार्ड दिखाई देगा। इस मॉडल कार्ड में मॉडल के प्रशिक्षण विवरण और मॉडल में क्या विशेषताएं हैं, इसके बारे में जानकारी शामिल है। हमारा मॉडल रोबर्टा-बेस है जिसे भावना विश्लेषण के लिए 58M ट्वीट्स पर प्रशिक्षित किया गया है। इस मॉडल में तीन मुख्य वर्ग लेबल हैं और यह प्रत्येक इनपुट को उसके प्रासंगिक वर्ग लेबल में वर्गीकृत करता है।

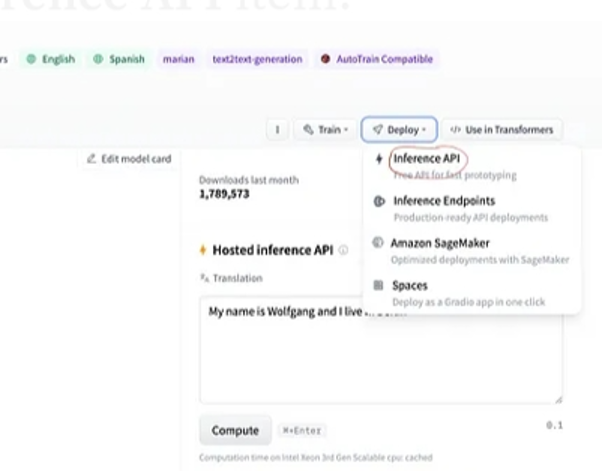

मॉडल के चयन के बाद, यदि हम परिनियोजन बटन का चयन करते हैं जो विंडो के ऊपरी दाएं कोने में मौजूद है, तो यह एक ड्रॉप-डाउन मेनू खोलता है। इस मेनू से, हमें 'अनुमान एपीआई' विकल्प का चयन करना होगा।

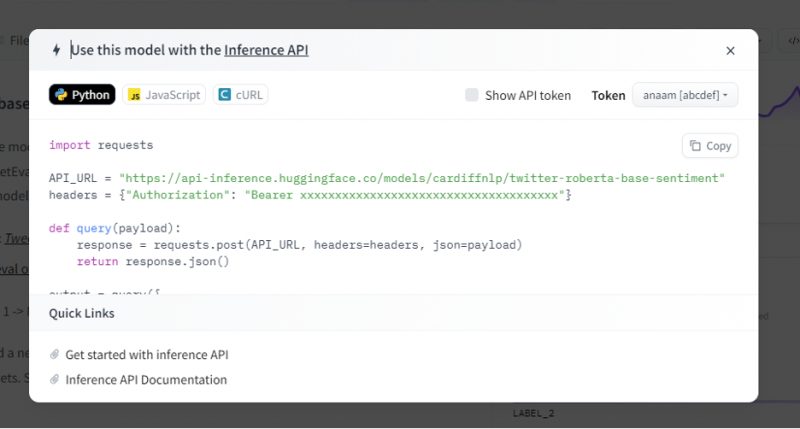

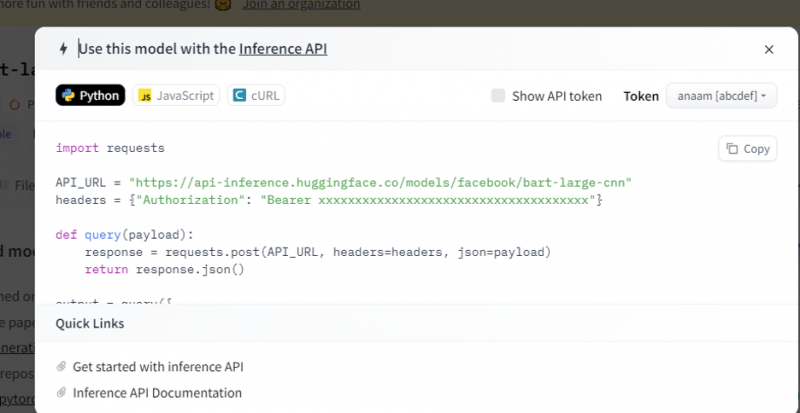

फिर अनुमान एपीआई इस अनुमान के साथ इस विशिष्ट मॉडल का उपयोग करने के तरीके की पूरी व्याख्या प्रदान करता है और हमें एआई मॉडल के लिए जल्दी से प्रोटोटाइप बनाने की सुविधा देता है। अनुमान एपीआई विंडो उस कोड को प्रदर्शित करती है जो पायथन की स्क्रिप्ट में लिखा गया है।

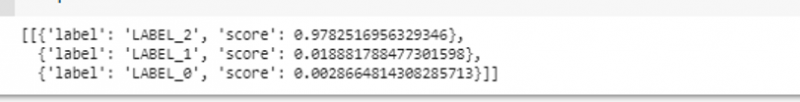

हम इस कोड को कॉपी करते हैं और किसी भी पायथन आईडीई में इस कोड को निष्पादित करते हैं। इसके लिए हम Google Colab का उपयोग करते हैं। इस कोड को पायथन शेल में निष्पादित करने के बाद, यह एक आउटपुट देता है जो स्कोर और लेबल भविष्यवाणी के साथ आता है। यह लेबल और स्कोर हमारे इनपुट के अनुसार दिया गया है क्योंकि हमने 'टेक्स्ट-सेंटिमेंट विश्लेषण' मॉडल चुना है। फिर, हम मॉडल को जो इनपुट देते हैं वह एक सकारात्मक वाक्य है और मॉडल को तीन लेबल वर्गों पर पूर्व-प्रशिक्षित किया गया था: लेबल 0 का अर्थ नकारात्मक है, लेबल 1 का अर्थ तटस्थ है, और लेबल 2 सकारात्मक पर सेट है। चूँकि हमारा इनपुट एक सकारात्मक वाक्य है, मॉडल से स्कोर भविष्यवाणी अन्य दो लेबलों से अधिक है जिसका अर्थ है कि मॉडल ने वाक्य की भविष्यवाणी 'सकारात्मक' के रूप में की है।

आयात अनुरोधएपीआई_यूआरएल = 'https://api-inference.huggingface.co/models/cardiffnlp/twitter-roberta-base-sentiment'

हेडर = { 'प्राधिकरण' : 'वाहक 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' }

डीईएफ़ जिज्ञासा ( पेलोड ) :

जवाब = अनुरोध. डाक ( एपीआई_यूआरएल , हेडर = हेडर , json = पेलोड )

वापस करना जवाब। json ( )

आउटपुट = जिज्ञासा ( {

'इनपुट' : 'जब तुम मेरे साथ हो तो मुझे अच्छा लगता है' ,

} )

आउटपुट:

उदाहरण 2: अनुमान के माध्यम से सारांश मॉडल

हम उन्हीं चरणों का पालन करते हैं जो पिछले उदाहरण में दिखाए गए हैं और हगिंग फेस से इसके अनुमान एपीआई का उपयोग करके सारांश मॉडल बस का प्रोटोटाइप बनाते हैं। सारांशीकरण मॉडल एक पूर्व-प्रशिक्षित मॉडल है जो पूरे पाठ को सारांशित करता है जिसे हम इसे इनपुट के रूप में देते हैं। हगिंग फेस खाते पर जाएं, शीर्ष मेनू बार से मॉडल पर क्लिक करें, और फिर उस मॉडल को चुनें जो सारांश के लिए प्रासंगिक है, इसे चुनें, और इसके मॉडल कार्ड को ध्यान से पढ़ें।

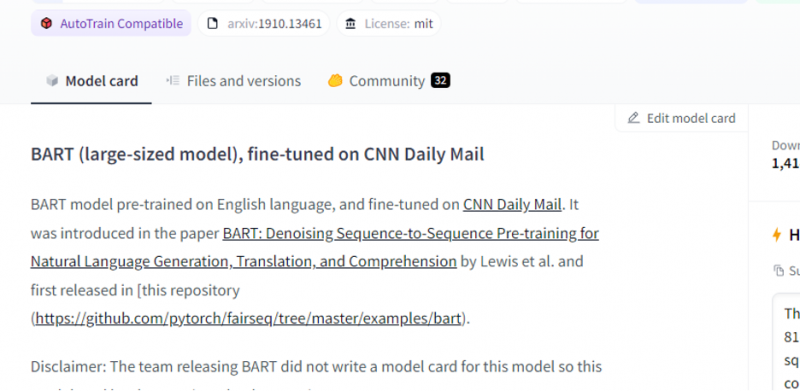

हमने जो मॉडल चुना है वह एक पूर्व-प्रशिक्षित BART मॉडल है और यह डेटासेट CNN dail मेल से बारीकी से जुड़ा हुआ है। BART एक मॉडल है जो BERT मॉडल के समान है जिसमें एक एनकोडर और डिकोडर होता है। यह मॉडल तब प्रभावी होता है जब इसे समझ, सारांश, अनुवाद और पाठ-निर्माण कार्यों के लिए ठीक किया जाता है।

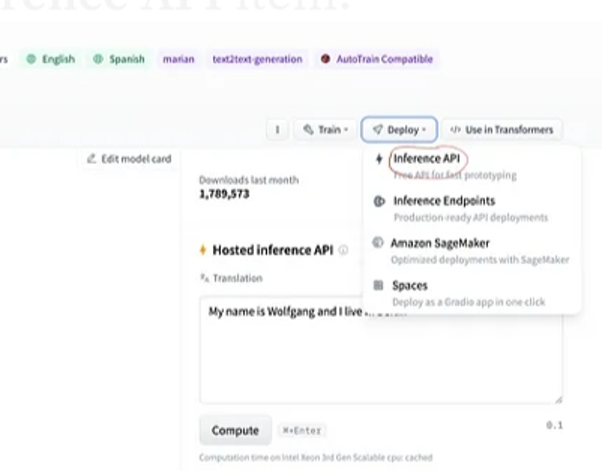

फिर, शीर्ष दाएं कोने से 'परिनियोजन' बटन चुनें और ड्रॉप-डाउन मेनू से अनुमान एपीआई चुनें। अनुमान एपीआई एक और विंडो खोलता है जिसमें इस अनुमान के साथ इस मॉडल का उपयोग करने के लिए कोड और दिशानिर्देश शामिल हैं।

इस कोड को कॉपी करें और इसे पायथन शेल में निष्पादित करें।

मॉडल आउटपुट लौटाता है जो उस इनपुट का सारांश है जिसे हमने उसे खिलाया है।

निष्कर्ष

हमने हगिंग फेस इंफ़रेंस एपीआई पर काम किया और सीखा कि हम पूर्व-प्रशिक्षित भाषा मॉडल के साथ काम करने के लिए इस एप्लिकेशन के प्रोग्रामेबल इंटरफ़ेस का उपयोग कैसे कर सकते हैं। लेख में हमने जो दो उदाहरण दिए वे मुख्य रूप से एनएलपी मॉडल पर आधारित थे। यदि हम अपने अनुप्रयोगों में एआई मॉडल का तेज़ एकीकरण प्रदान करके एक तेज़ प्रोटोटाइप विकसित करना चाहते हैं तो हगिंग फेस एपीआई अद्भुत काम कर सकता है। संक्षेप में, हगिंग फेस के पास सुदृढीकरण सीखने से लेकर कंप्यूटर विज़न तक आपकी सभी समस्याओं का समाधान है।